K (CSS added) |

|||

| Zeile 1: | Zeile 1: | ||

{{#css:GPN12:Stylesheet}} | |||

== Riesentouchpad aus Beamer und Kinect == | == Riesentouchpad aus Beamer und Kinect == | ||

Das Ziel des Projekts ist ein großer Touchscreen aus einem Beamer und einer Kinect. Mit dem Beamer kann man beliebige Inhalte auf den Boden, einen Tisch oder eine Wand projizieren, mit der Kinect kann man feststellen, wenn jemand die Fläche berührt. | Das Ziel des Projekts ist ein großer Touchscreen aus einem Beamer und einer Kinect. Mit dem Beamer kann man beliebige Inhalte auf den Boden, einen Tisch oder eine Wand projizieren, mit der Kinect kann man feststellen, wenn jemand die Fläche berührt. | ||

Version vom 22. März 2012, 14:34 Uhr

Riesentouchpad aus Beamer und Kinect

Das Ziel des Projekts ist ein großer Touchscreen aus einem Beamer und einer Kinect. Mit dem Beamer kann man beliebige Inhalte auf den Boden, einen Tisch oder eine Wand projizieren, mit der Kinect kann man feststellen, wenn jemand die Fläche berührt. Interaktive Hüpfkästchen oder ein interaktiver Tisch wären damit dann gut machbar.

Die Technik dahinter ist nichts Neues, nur habe ich bisher keine OpenSource Lösung für diese Anwendung gesehen und ich glaube, dass man mit dieser Riesen-Touchpad viel Spaß haben kann.

Um während der GPN was vorzeigbares bauen zu können, habe ich in den letzten Wochen einen ersten Prototypen implementiert.

Aktueller Zwischenstand:

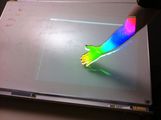

Beamer und Projector können schnell und einfach kalibriert werden (dauert 30s), so dass jeder Punkt in der Welt beliebig gefärbt werden kann. Hier sind ein paar DemoBilder, was möglich ist:

Auf den ersten beiden Bildern wird alles gefärbt, was sich vor der Wand befindet. Beim Farbverlauf wurde die Entfernung zur Wand auf eine Farbskala übertragen und jeder Punkt mit seiner entsprechenden Farbe angestrahlt. Für das letzte Bild hat einer unserer Roboter (ein PR2 von Willow Garage) Model gestanden. Hier hängt die Farbe vom Abstand zum Fußboden ab.

Bau des Touchpads

Da der Beamer meist nicht direkt über dem Feld installiert werden kann, wird das Bild recht stark verzerrt werden, was algorithmisch ausgeglichen werden sollte. Zudem muss klar sein, welches Pixel angesprochen werden muss, wenn ein bestimmter Fleck auf dem Tisch seine Farbe wechseln soll. Daher ist es notwendig, die Position des Beamers und der Kinect relativ zum Tisch zu bestimmen. Für die Kinect mit der Tiefeninformation ist das recht einfach machbar, für den Beamer muss man dann etwas Mathe rausholen. Für die Beamerkalibrierung (Bestimmung der Projektionsmatrix/Homographie) kann man den Beamer als inverse Kamera betrachten und über die normalen markerbasierten Algorithmen gehen.

Kalibrierungsmuster

Die Marker werden im Kinect-Bild erkannt und mit der bekannten Tiefe können ihnen 3d-Positionen zugeordnet werden. Diese Positionen werden dann in Tischkoordinaten (x,y,0) umgerechnet, und damit die Projektionsmatrix berechnet. Soll dann ein bestimmes Bild auf dem Tisch angezeigt werden, kann darüber die auszugleichende Verzerrung berechnet werden. Weiter Bilder auch im github.

Erkennung der Nutzerinteraktion

Über die Tiefenwerte wird eine Ebene in den Tisch gefittet. Für jeden Punkt, den die Kinect sieht, kann damit der Abstand der Ebene und der nächste Punkt in der Ebene berechnet werden. Sobald ein Punkt sehr nahe am Tisch ist, kann ein MouseDown ausgelöst werden, und das Object verfolgt werden, bis es sich wieder vom Tisch entfernt, was dann ein MouseUp darstellt. Bewegt sich ein Objekt nahe der Oberfläche (2-20cm) könnte auch ein MouseOver ausgegeben werden. Aufgaben hier wäre hier eine möglichst glatte Mausbewegung und eine Erkennung der verschiedenen Events. Da der Tisch multitouch-fähig sein soll, müssen auch mehrere Objekte gleichzeitig getrackt werden. (z.B. für eine Zoom-Geste mit zwei Händen).